Von euklidischem zu hyperbolischem Lernen für Domain Generalization: Unsere neueste Arbeit in TMLR

HypCBC: Domain-Invariant Hyperbolic Cross-Branch Consistency

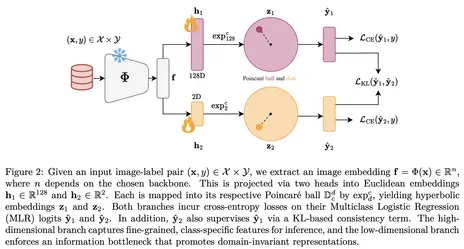

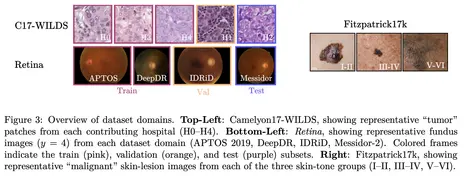

In dem Paper stellen wir HypCBC vor, eine Methode, die Embeddings aus einem eingefrorenen Foundation Model in einen hyperbolischen Raum projiziert und via einer dedizierten Zwei-Zweig-Trainingsstrategie lernt. Die zentrale Idee besteht darin, einen hochdimensionalen Zweig, der feingranulare Informationen erfasst, mit einem niedrigdimensionalen Zweig zu kombinieren, der als Informationsengpass dient und domäneninvariante Repräsentationen fördert. Ein Cross-Branch-Consistency-Ziel überträgt anschließend robuste, domänenagnostische Informationen zwischen den beiden Zweigen. Über elf Datensätze der medizinischen Bildgebung und drei Vision-Transformer-Backbones hinweg übertreffen hyperbolische Embeddings konsistent euklidische, und unser HypCBC verbessert die Domain Generalization zusätzlich auf anspruchsvollen Benchmarks in der Dermatologie, Histopathologie und retinalen Bildgebung. Die Methode ist effizient, model-agnostisch und besonders gut für robuste medizinische KI unter Verteilungsverschiebungen geeignet.

Über TMLR

Transactions on Machine Learning Research (TMLR) ist ein neues Publikationsforum für die Verbreitung von Forschung im Bereich Machine Learning, das als Ergänzung zum Journal of Machine Learning Research (JMLR) gedacht ist und zugleich die Bedürfnisse einer wachsenden ML-Community unterstützt.